资讯专栏INFORMATION COLUMN

摘要:在过去五年里,我碰巧使用了一个收藏了篇机器学习论文的数据库,这些论文都来自于。因此,本文将这五年间机器学习的发展趋势进行了简单的总结。我们得到了如下结果是的,年月份,接受了多篇与机器学习领域有关的论文。

机器学习的趋势概述

如果你用过谷歌趋势(Google Trends),你一定会发现它很酷——你输入一些关键词,你就能够看到这些关键词的谷歌搜索量是如何随着时间而变化的。在过去五年里,我碰巧使用了一个收藏了28303篇机器学习论文的arxiv-sanity数据库,这些论文都来自于arXiv。因此,本文将这五年间机器学习的发展趋势进行了简单的总结。

让我们通过arxiv-sanity的类别目录 (cs.AI,cs.LG,cs.CV,cs.CL,cs.NE,stat.ML),首先看看提交的总论文数。我们得到了如下结果:

是的,2017年3月份,接受了2000多篇与机器学习领域有关的论文。并且,这些峰值很可能受到了会议截止时间(例如NIPS/ICML)的影响。请注意,这并不是有关于此领域本身规模的声明,因为并不是所有人都将论文提交到arXiv上。我们将提交的论文总数作为分母,来看看包含我们感兴趣的某些关键词的论文占了多少。

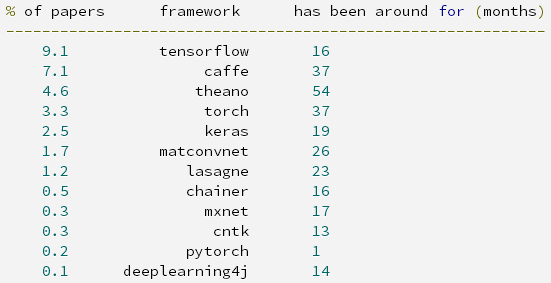

12大深度学习框架

首先,让我们看看现在正在使用的深度学习框架。为了计算,我们记录了在全文任何地方(包括参考文章等)提到过这些框架的论文,对于2017年3月上传的论文,我们得到如下了结果:

我们可以看出,在2017年3月提交的所有论文中,有10%的论文提到了TensorFlow。当然,并不是所有的论文都宣布了它们使用的框架。但是,如果我们假定宣布了此框架但实际上并没有使用此框架的论文占有一些固定的随机概率,那么大概有40%的社区正在使用TensorFlow。下面是一些流行的框架随着时间的使用图:

机器学习算法框架的使用程度分析

我们看到,Theano已经出现一段时间了,但是它的使用增长情况却有些停滞不前。Caffe的使用在2014年爆发式地增长,但是在过去几个月被TensorFlow超越。Torch(和最近的PyTorch)使用情况也在上升,但较为缓慢,比较稳定。在接下来的几个月中,看这些趋势如何变化也会很有趣。我认为,Caffe/Theano 使用将会缓慢减少,由于PyTorch,TF的使用增长将会上升地缓慢一些。

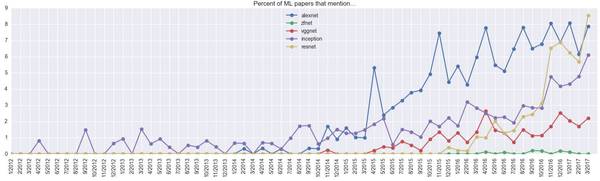

卷积模型:

有趣的是,如果我们看一下常见的卷积神经网络,情况又如何呢?在这里,我们可以清楚的看到,循环神经网络的使用迅速飙升,在今年3月的论文中,循环神经网络的比例占到了9%。

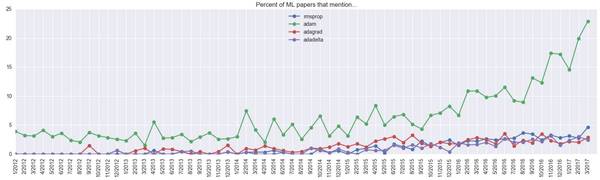

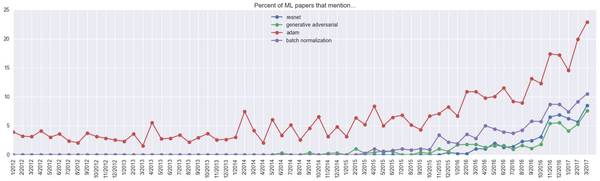

优化算法:

在优化算法方面,似乎Adam算法很热门,占到了23%!实际比例难以估计,它可能高于23%,因为一些论文没有宣布它们所使用的优化算法,并且很大一部分论文甚至可能没有优化任何神经网络;这一比例也可能降低约5%,因为“Adam”可能与某些作者的名字相同了……尽管Adam算法仅仅才发布了不到3年,但是的确很流行。

我也很好奇地绘出了深度学习中提到的一些具有较高PIs(类似于引用次数,但是1)使用“0/1”实现计数,它更强大;2)它被归一化)的图,如下:

有几件事需要注意:提交的论文中有35%提到了“bengio”,但是这里有两个“bengio”:Samy和Yoshua,将他们也添加到了图上。特别地, 有30%的新论文中提到了Geoff Hinton!

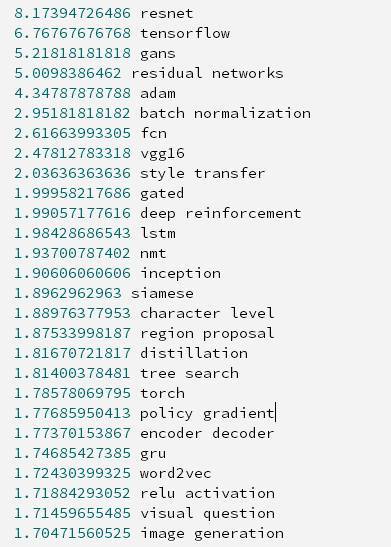

27个ML框架最热门关键词

有很多方法来定义最热门关键词。但是对于本实验,我查看了每篇论文中的一元或二元词组,并记录了它们相对于去年出现次数的较大比率。具体方式是记录相关词组去年的出现频次,然后今年的出现频次比去年高得多,比率=今年出现的频次/去年出现的频次。较大比率靠前的包括如下:

例如,ResNet的比率是8.17。这是因为一年前,所有提交的论文中,与ResNet有关的论文占1.004%(在2016年3月),但是2017年3月,所有提交的论文中,ResNet有关的论文占了8.53%,所以8.53 / 1.044 ~= 8.17。所以你可以得出如下结论:过去一年流行的核心创新包括1) ResNets, 2) GANs, 3) Adam, 4) BatchNorm。在研究兴趣方面,我们看到了1)兴趣转移,2)深度强化学习,3)神经机器翻译,可能还有4)图像生成。在架构上,热点是1)全连接神经网络,2)LSTMs/GRUs,3)Siamese网络,4)编码解码器网络。

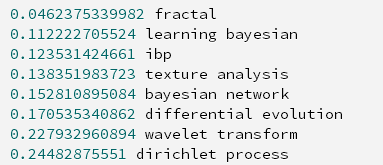

反之如何?过去一年,过去比较流行的论文方向现在开始没落了,这包括如下:

我不知道“fractal”是什么,但是更一般地说,它就像贝叶斯非参数模型一样正受到威胁。

调查结论:现在是时候提交用Adam优化算法解决全连接神经网络编码解码器、用于Style Transfer的BatchNorm ResNet GAN等有关的论文了。

欢迎加入本站公开兴趣群商业智能与数据分析群

兴趣范围包括各种让数据产生价值的办法,实际应用案例分享与讨论,分析工具,ETL工具,数据仓库,数据挖掘工具,报表系统等全方位知识

QQ群:81035754

文章版权归作者所有,未经允许请勿转载,若此文章存在违规行为,您可以联系管理员删除。

转载请注明本文地址:https://www.ucloud.cn/yun/4515.html

摘要:深度学习框架作为热身,我们先看一下深度学习框架。在年有急剧的增长,但在过去几个月被超越。 你是否使用过 Google Trends?相当的酷,你在里面输入关键词,看一下谷歌搜索中这一词条如何随时间变化的。我想,过去 5 年中 arxiv-sanity 数据库中刚好有 28303 篇机器学习论文,为什么不做一些类似的工作,看一下过去 5 年机器学习研究有何进化?结果相当的有趣,所以我把它贴了出...

摘要:值得一提的是每篇文章都是我用心整理的,编者一贯坚持使用通俗形象的语言给我的读者朋友们讲解机器学习深度学习的各个知识点。今天,红色石头特此将以前所有的原创文章整理出来,组成一个比较合理完整的机器学习深度学习的学习路线图,希望能够帮助到大家。 一年多来,公众号【AI有道】已经发布了 140+ 的原创文章了。内容涉及林轩田机器学习课程笔记、吴恩达 deeplearning.ai 课程笔记、机...

摘要:自从年深秋,他开始在上撰写并公开分享他感兴趣的机器学习论文。本文选取了上篇阅读注释的机器学习论文笔记。希望知名专家注释的深度学习论文能使一些很复杂的概念更易于理解。主要讲述的是奥德赛因为激怒了海神波赛多而招致灾祸。 Hugo Larochelle博士是一名谢布克大学机器学习的教授,社交媒体研究科学家、知名的神经网络研究人员以及深度学习狂热爱好者。自从2015年深秋,他开始在arXiv上撰写并...

摘要:康纳尔大学数学博士博士后则认为,图神经网络可能解决图灵奖得主指出的深度学习无法做因果推理的核心问题。图灵奖得主深度学习的因果推理之殇年初,承接有关深度学习炼金术的辩论,深度学习又迎来了一位重要的批评者。 作为行业的标杆,DeepMind的动向一直是AI业界关注的热点。最近,这家世界最较高级的AI实验室似乎是把他们的重点放在了探索关系上面,6月份以来,接连发布了好几篇带关系的论文,比如:关系归...

阅读 3650·2021-09-22 15:50

阅读 3303·2019-08-30 15:54

阅读 2840·2019-08-30 14:12

阅读 3139·2019-08-30 11:22

阅读 2160·2019-08-29 11:16

阅读 3650·2019-08-26 13:43

阅读 1297·2019-08-23 18:33

阅读 996·2019-08-23 18:32