资讯专栏INFORMATION COLUMN

摘要:我们还经验性地演示了贝叶斯在语言建模基准和生成图说任务上优于传统,以及通过使用不同的训练方案,这些方法如何改进我们的模型。第节和第节分别回顾了通过反向传播做贝叶斯,和通过时间做反向传播。

摘要

在这项工作里,我们探讨了一种用于 RNN 的简单变分贝叶斯方案(straightforward variational Bayes scheme)。首先,我们表明了一个通过时间截断反向传播的简单变化,能够得出良好的质量不确定性估计和优越的正则化结果,在训练时只需花费很小的额外计算成本。其次,我们展示了一种新的后验近似,能够如何进一步改善贝叶斯 RNN 的性能。我们将局部梯度信息合并到近似后验,以便在当前批次统计数据周围对其进行锐化。这种技术并不仅限于循环神经网络(RNN),还可以更广泛地应用于训练贝叶斯神经网络。我们还经验性地演示了贝叶斯 RNN 在语言建模基准和生成图说任务上优于传统 RNN,以及通过使用不同的训练方案,这些方法如何改进我们的模型。 我们还引入了一个新的基准来研究语言模型的不确定性,便于未来研究的对比。

背景:将贝叶斯方法用于训练,增加 RNN 不确定性和正则化

循环神经网络(RNN)在一系列广泛的序列预测任务上取得了业内较高水平的性能(Wu et al., 2016; Amodei et al., 2015; Jozefowicz et al., 2016; Zaremba et al., 2014; Lu et al., 2016)。在这项工作中,我们将通过将贝叶斯方法用于训练,考察如何在 RNN 中增加不确定性和正则化。

贝叶斯方法为 RNN 提供了另一种表达不确定性的方法(通过参数)。同时,使用一个先验(prior)将各种参数整合,使许多模型在训练期间平均化,使网络实现正则化的效果。近来,有的方法试图将 dropout(Srivastava et al,2014)和权重衰减证明为一种变分推理的方案(Gal&Ghahramani,2016),或者应用随机梯度 Langevin dynamics(Welling&Teh,2011,SGLD)在时间上直接截断反向传播(Gan et al,2016)。

四大贡献

有趣的是,最近的工作还没有进一步研究像 Graves(2011)所做的那样,直接应用变分贝叶斯推理方案(Beal,2003)。(注释:原文没有提到 Graves 2011 年的工作,这里是有人在 Reddit 上指出后,Oriol Vinyals 立即做的修改。)

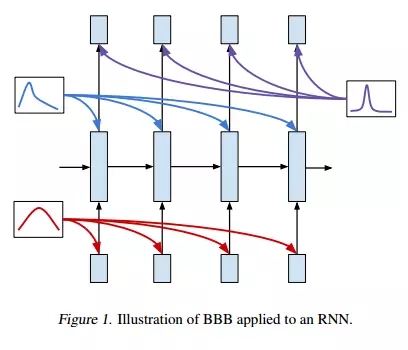

我们在(Blundell et al,2015)Bayes by Backprop 工作的基础上,提出了一个简单直接的方法,经过实验表明能够解决很大规模的问题。

我们的方法是对通过时间截断反向传播的一个简单改变,得到了对 RNN 权重后验分布的估计。

将贝叶斯方法应用于成功的深度学习模型有两大好处:对不确定性和正则化的明确表征。我们的公式明确地导出了一个有信息理论支撑的成本函数(cost function)。

变分推理后验的形式决定了不确定性估计的质量,从而影响着模型的整体表现。我们将展示如何在批次的局部调整(“锐化”)后验,提高 RNN 的性能。这种锐化使用基于批次的梯度来调整一个批次数据的变分后验。这一过程可以被视为层次化分布(hierarchical distribution),其中局部批次梯度被用于调整全局的后验,在每个批次都形成一个局部近似。

将变分推理应用于神经网络时,这为高斯后验(Gaussian posterior)的典型假设提供了更灵活的形式,减小了方差(variance)。这种技术可以在其他变分贝叶斯模型中更广泛地应用。

我们展示了如何将 Backprop By Bayes(BBB)有效应用于 RNN。

我们开发了一种减少 BBB 方差的新技术,可以被广泛地用于其他较大似然框架当中。

我们在两项经过广泛研究的基准上提高了测试结果,性能大幅超越了现有的正则化技术,比如 dropout。

我们为研究语言模型的不确定性提出了新的基准。

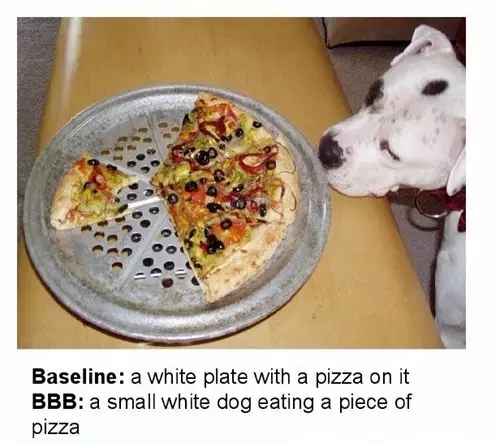

实验结果:图说生成超越现有基准

作者在论文中给出了他们新方法在图说生成在 MSCOCO 上与此前方法的对比。可以看出,BBB 相较以前的结果有显著提升。

论文的其余部分组织如下。第 2 节和第 3 节分别回顾了通过反向传播做贝叶斯(Bayes by Backprop,BBB)和通过时间做反向传播(Backprop through time)。第 4 节推导出了用于 RNN 的 Bayes by Backprop,而第 5 节描述了后验的锐化。第 6 节简要回顾了相关工作。第 7 节做了实验评估,最后在第 8 节进行讨论并得出结论。

论文地址:https://arxiv.org/abs/1704.02798

欢迎加入本站公开兴趣群商业智能与数据分析群

兴趣范围包括各种让数据产生价值的办法,实际应用案例分享与讨论,分析工具,ETL工具,数据仓库,数据挖掘工具,报表系统等全方位知识

QQ群:81035754

文章版权归作者所有,未经允许请勿转载,若此文章存在违规行为,您可以联系管理员删除。

转载请注明本文地址:https://www.ucloud.cn/yun/4527.html

摘要:康纳尔大学数学博士博士后则认为,图神经网络可能解决图灵奖得主指出的深度学习无法做因果推理的核心问题。图灵奖得主深度学习的因果推理之殇年初,承接有关深度学习炼金术的辩论,深度学习又迎来了一位重要的批评者。 作为行业的标杆,DeepMind的动向一直是AI业界关注的热点。最近,这家世界最较高级的AI实验室似乎是把他们的重点放在了探索关系上面,6月份以来,接连发布了好几篇带关系的论文,比如:关系归...

摘要:年以来,深度学习方法开始在目标跟踪领域展露头脚,并逐渐在性能上超越传统方法,取得巨大的突破。值得一提的是,目前大部分深度学习目标跟踪方法也归属于判别式框架。 开始本文之前,我们首先看上方给出的3张图片,它们分别是同一个视频的第1,40,80帧。在第1帧给出一个跑步者的边框(bounding-box)之后,后续的第40帧,80帧,bounding-box依然准确圈出了同一个跑步者。以上展示的其...

摘要:因为深度学习的正统观念在该领域已经很流行了。在机器和深度学习空间中进行的大多数数学分析倾向于使用贝叶斯思想作为参数。如果我们接受了目前深度学习的主流观点任何一层的微分都是公平的,那么或许我们应该使用存储多种变体的复分析。 深度学习只能使用实数吗?本文简要介绍了近期一些将复数应用于深度学习的若干研究,并指出使用复数可以实现更鲁棒的层间梯度信息传播、更高的记忆容量、更准确的遗忘行为、大幅降低的网...

摘要:摘要在年率先发布上线了机器翻译系统后,神经网络表现出的优异性能让人工智能专家趋之若鹜。目前在阿里翻译平台组担任,主持上线了阿里神经网络翻译系统,为阿里巴巴国际化战略提供丰富的语言支持。 摘要: 在2016年Google率先发布上线了机器翻译系统后,神经网络表现出的优异性能让人工智能专家趋之若鹜。本文将借助多个案例,来带领大家一同探究RNN和以LSTM为首的各类变种算法背后的工作原理。 ...

阅读 3502·2023-04-25 20:43

阅读 1974·2021-09-30 09:54

阅读 1870·2021-09-24 09:47

阅读 3134·2021-09-06 15:02

阅读 3785·2021-02-22 17:09

阅读 1495·2019-08-30 15:53

阅读 1663·2019-08-29 17:04

阅读 2210·2019-08-28 18:22